, /PRNewswire/ — United Imaging Intelligence (UII) hat uAI NEXUS MedVLM vorgestellt, ein bahnbrechendes großes Sprachmodell für medizinische Videos, das in klinischen Umgebungen eine beispiellose räumliche und zeitliche Präzision bietet.

UII stellt das Modell vollständig als Open Source zur Verfügung und führt einen neuen umfassenden Benchmark für die branchenweite Bewertung ein. Die Forschungsarbeit wurde von der CVPR 2026, einer der führenden KI-Konferenzen, angenommen, was die Anerkennung durch die globale Computer-Vision-Community unterstreicht.

uAI NEXUS MedVLM basiert auf einem monumentalen Datensatz, der 531.850 Video-Anweisungs-Paare aus 8 klinischen Szenarien umfasst, darunter Roboterchirurgie, laparoskopische Eingriffe, Endoskopie, offene Chirurgie und Pflege.

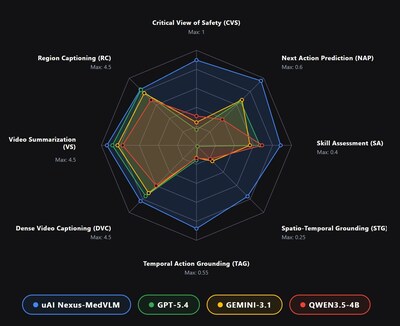

Mit nur 4B/7B Parametern übertrifft uAI NEXUS MedVLM führende allgemeine Basismodelle, darunter GPT-5.4 und Gemini 3.1, bei wichtigen medizinischen Videoaufgaben deutlich. Es erreicht eine Genauigkeit von 89,4 % bei der Bewertung der chirurgischen Sicherheit, verglichen mit GPT-5.4 (1,8 %) und Gemini 3.1 (10,1 %). Bei der räumlich-zeitlichen Aktionslokalisierung liefert es einen bis zu 14-mal höheren mIoU-Wert als GPT-5.4 und einen 4-mal höheren als Gemini 3.1. Bei der Erstellung von Videoberichten erreicht es 4,2 von 5 Punkten und übertrifft damit GPT-5.4 (2,5) und Gemini 3.1 (2,4) deutlich.

(Quelle: Die obigen Leistungsstatistiken stammen aus dem Forschungspapier: https://arxiv.org/abs/2512.06581)

Start einer globalen offenen Challenge zur Beschleunigung gemeinsamer Innovationen

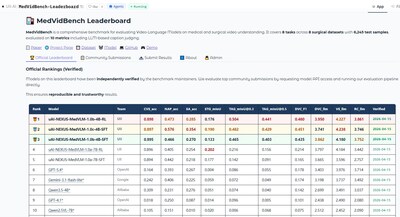

Um die Entwicklung von LLM-Modellen für medizinische Videos voranzutreiben, hat das UII mit der schrittweisen Veröffentlichung seines Datensatzes „MedVidBench” begonnen, beginnend mit der Open-Source-Veröffentlichung von 6.245 streng geprüften Benchmark-Testproben. Diese Initiative, die acht unterschiedliche chirurgische Datensätze umfasst, stellt sowohl hinsichtlich des Umfangs als auch der klinischen Präzision eine weltweite Premiere dar.

Entwickler können ihre Modelle auf einer einheitlichen Rangliste bewerten, auf der die eingereichten Beiträge automatisch anhand privater Referenzdaten bewertet werden. Die Ergebnisse spiegeln sich in einer kontinuierlich aktualisierten globalen Rangliste wider, die eine transparente und vergleichbare Leistungsbewertung der verschiedenen Modelle ermöglicht.

UII lädt KI-Forscher, Entwickler und Gesundheitseinrichtungen weltweit ein, an dieser offenen Herausforderung teilzunehmen und durch kollaborative Innovation zur Weiterentwicklung der medizinischen Video-Intelligenz beizutragen.

Projektseite: https://uii-ai.github.io/MedGRPO/

Intelligenzförderung über das gesamte Spektrum medizinischer Videoaufgaben

Das Verständnis medizinischer Videos ist seit langem eine der größten Herausforderungen in der künstlichen Intelligenz – es erfordert mikroskopisches räumliches Bewusstsein, komplexe zeitliche Logik und kompromisslose klinische Genauigkeit. In der Vergangenheit wurde der Fortschritt durch den gravierenden Mangel an klinischen Daten und die unerschwinglichen Kosten für Expertenannotationen gebremst.

UII hat diesen Engpass überwunden. Durch die Entwicklung eines umfangreichen Frame-für-Frame-Annotations-Frameworks für vielfältige klinische Videos haben wir kritische Attribute rigoros erfasst: Instrumentenbahnen, räumliche Positionierung, präzise chirurgische Handgriffe und entscheidende Risikoindikatoren. Diese beispiellose Datenbasis stattet uAI NEXUS MedVLM mit einem vollständigen, robusten klinischen Intelligenz-Stack aus.

Auf dieser Grundlage integriert das Modell nahtlos die Wahrnehmung, das Denken und die Entscheidungsfindung. Es liefert eine hochpräzise räumlich-zeitliche Lokalisierung von Instrumenten und automatisierte Verfahrenserkennung und wandelt komplexe Videosequenzen mithilfe fortschrittlicher Schlussfolgerungen in strukturierte klinische Berichte, regionale Beschreibungen und schnelle Arbeitsablaufzusammenfassungen um. Über die passive Beobachtung hinaus hebt es diese Erkenntnisse in aktive Entscheidungsfindung, die die Vorhersage des nächsten Schritts, die Bewertung chirurgischer Fähigkeiten und eine umfassende Sicherheitsrisikobewertung unterstützt.

KI-Innovation in klinische Wirkung in der Praxis umsetzen

uAI NEXUS MedVLM wurde für den klinischen Einsatz entwickelt und ermöglicht fundiertere Entscheidungsfindung sowie datengesteuerte Qualitätskontrolle über chirurgische Arbeitsabläufe hinweg, während es gleichzeitig die Lernkurve für Kliniker verkürzt und die Effizienz und Konsistenz der Schulung verbessert.

Mit Blick auf die Zukunft kann uAI NEXUS MedVLM als zentrale Wahrnehmungs- und Kognitions-Engine für verkörperte KI dienen, die in der physischen Welt agiert. Zusammen bilden sie ein geschlossenes System aus visueller Wahrnehmung, kognitivem Denken und physischer Ausführung, das den Weg zu einem stärker automatisierten, standardisierten und intelligenten Gesundheitsökosystem ebnet.

Foto – https://mma.prnewswire.com/media/2964990/image1.jpg

Foto – https://mma.prnewswire.com/media/2964989/image2.jpg