, /PRNewswire/ — United Imaging Intelligence (UII) a dévoilé l’uAI NEXUS MedVLM, un grand modèle de langage (LLM) vidéo médical, qui fournit une précision spatiale et temporelle sans précédent dans les environnements cliniques.

UII rend le modèle entièrement open source et introduit une nouvelle référence complète pour l’évaluation de l’ensemble du secteur. La recherche a été acceptée par le CVPR 2026, l’une des principales conférences sur l’IA, ce qui souligne sa reconnaissance par la communauté mondiale de la vision par ordinateur.

L’uAI NEXUS MedVLM s’appuie sur un ensemble de données colossal comprenant 531 850 paires de vidéo-instructions dans huit scénarios cliniques, dont la chirurgie robotique, les procédures laparoscopiques, l’endoscopie, la chirurgie ouverte et les soins infirmiers.

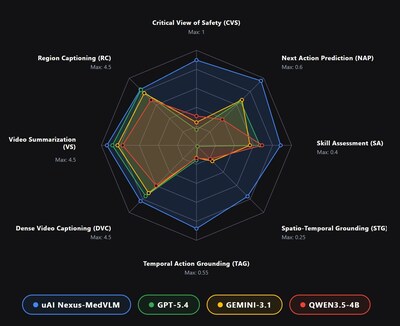

Avec seulement 4 à 7 milliards de paramètres, l’uAI NEXUS MedVLM surpasse de manière significative les principaux modèles de base polyvalents, notamment GPT-5.4 et Gemini 3.1, dans les tâches clés de la vidéo médicale. Il atteint une précision de 89,4 % dans l’évaluation de la sécurité chirurgicale, par rapport à GPT-5.4 (1,8 %) et Gemini 3.1 (10,1 %). En ce qui concerne la localisation spatio-temporelle d’actions, il fournit une mIoU jusqu’à 14 fois supérieure à celle de GPT-5.4 et 4 fois supérieure à celle de Gemini 3.1. Pour la génération de rapports vidéo, il obtient une note de 4,2 sur 5, dépassant largement GPT-5.4 (2,5) et Gemini 3.1 (2,4).

(Source : les statistiques de performance ci-dessus sont tirées du document de recherche : https://arxiv.org/abs/2512.06581)

Lancement d’un défi ouvert mondial pour accélérer l’innovation collaborative

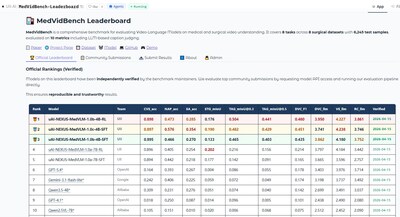

Afin de faire progresser le développement des LLM appliqué à la vidéo médicale, UII a lancé un déploiement progressif de son ensemble de données MedVidBench, en commençant par la publication en source ouverte de 6 245 échantillons de tests de référence rigoureux. Portant sur huit ensembles de données chirurgicales différents, cette initiative constitue une première mondiale en termes d’échelle et de précision clinique.

Les développeurs peuvent évaluer leurs modèles sur un tableau de classement unifié, où les soumissions sont automatiquement évaluées par rapport à des données de référence privées. Les résultats sont reflétés dans un classement mondial mis à jour en permanence, ce qui permet une évaluation transparente et comparable des performances des différents modèles.

UII invite les chercheurs en IA, les développeurs et les établissements de santé du monde entier à participer à ce défi ouvert et à contribuer à faire progresser l’intelligence vidéo médicale grâce à l’innovation collaborative.

Page du projet : https://uii-ai.github.io/MedGRPO/

Faire progresser l’intelligence dans l’ensemble des tâches liées à la vidéo médicale

La compréhension des vidéos médicales consitue depuis longtemps l’une des défis les plus redoutables de l’intelligence artificielle, exigeant une connaissance de l’espace microscopique, une logique temporelle complexe et une précision clinique sans compromis. Historiquement, les progrès ont été freinés par le manque criant de données cliniques et le coût prohibitif de l’annotation par des experts.

IIU a éliminé ce goulot d’étranglement. En élaborant un cadre d’annotation massif, image par image, à partir de diverses vidéos cliniques, nous avons rigoureusement cartographié les attributs critiques : les trajectoires des instruments, le positionnement dans l’espace, les gestes chirurgicaux précis et les indicateurs de risque cruciaux. Cette base de données sans précédent dote l’uAI NEXUS MedVLM d’une plateforme complète et robuste de veille clinique.

Sur cette base, le modèle intègre de manière transparente la perception, le raisonnement et la prise de décision. Il permet une localisation spatio-temporelle très précise des instruments et une reconnaissance automatisée des procédures, en appliquant un raisonnement avancé pour transformer des séquences vidéo complexes en rapports cliniques structurés, en descriptions régionales et en résumés de flux de travail rapides. Au-delà de l’observation passive, il transforme ces informations en une prise de décision active qui permet de prédire l’étape suivante, d’évaluer les compétences chirurgicales et d’évaluer l’ensemble des risques de sécurité.

Traduction de l’innovation en matière d’IA en impact clinique dans le monde réel

Conçu pour un déploiement clinique, l’uAI NEXUS MedVLM permet une prise de décision plus éclairée et un contrôle de la qualité basé sur les données dans les flux de travail chirurgicaux, tout en réduisant la courbe d’apprentissage pour les cliniciens et en améliorant l’efficacité et la cohérence de la formation.

À l’avenir, l’uAI NEXUS MedVLM pourra servir de moteur perceptif et cognitif central pour l’IA incarnée évoluant dans le monde physique. Ensemble, ils forment un système en boucle fermée de perception visuelle, de raisonnement cognitif et d’exécution physique, progressant vers un écosystème de santé plus automatisé, normalisé et intelligent.

Photo – https://mma.prnewswire.com/media/2964990/image1.jpg

Photo – https://mma.prnewswire.com/media/2964989/image2.jpg